Kommunernes oversete indsigter er gemt i tekst

maj 13, 2026

Når byrådene selv skal sætte retning for de kommende år, kræver det andre data end dem, regnearkene rummer. Sprogmodeller åbner kommunernes egen tekst som analytisk ressource – men kun hvis det analytiske håndværk holder.

Reformbølgen rammer kommunerne fra alle sider på én gang. Skole, ældre, sundhed, social, beskæftigelse og den grønne trepart skal hver især oversættes til lokal kontekst, og byrådene skal selv sætte retningen. Det stiller nye krav til samspillet mellem politikere og forvaltning. Retningen skal sættes lokalt, og løsningerne findes ikke i en manual – de skal udvikles undervejs, mens reformerne udrulles. Det er en arbejdsform, der kalder på en anden analytisk faglighed end den, hverdagens analyseopgaver typisk kræver.

Sprogmodeller åbner et nyt analytisk rum

Klassiske datakilder kan hjælpe kommunerne en del af vejen. Økonomiske nøgletal og registerdata gør det muligt at følge udviklinger over tid, benchmarke sig mod sammenlignelige kommuner, diagnosticere hvor problemerne vokser hurtigst, og kvantificere det økonomiske rum for en omprioritering. Det er fundamentet, og det skal ikke erstattes.

Men nogle af de spørgsmål, reformerne rejser, kan ikke besvares med tal alene. Hvordan har andre kommuner faktisk implementeret reformerne? Hvilke virkemidler har de valgt, hvilke har de skrottet, og hvad har de selv skrevet om resultaterne? Hvordan er en politisk aftale fra sidste valgperiode reelt blevet til ændret praksis i forvaltningens egne indstillinger, og hvordan kan man se den afspejlet lokalt?

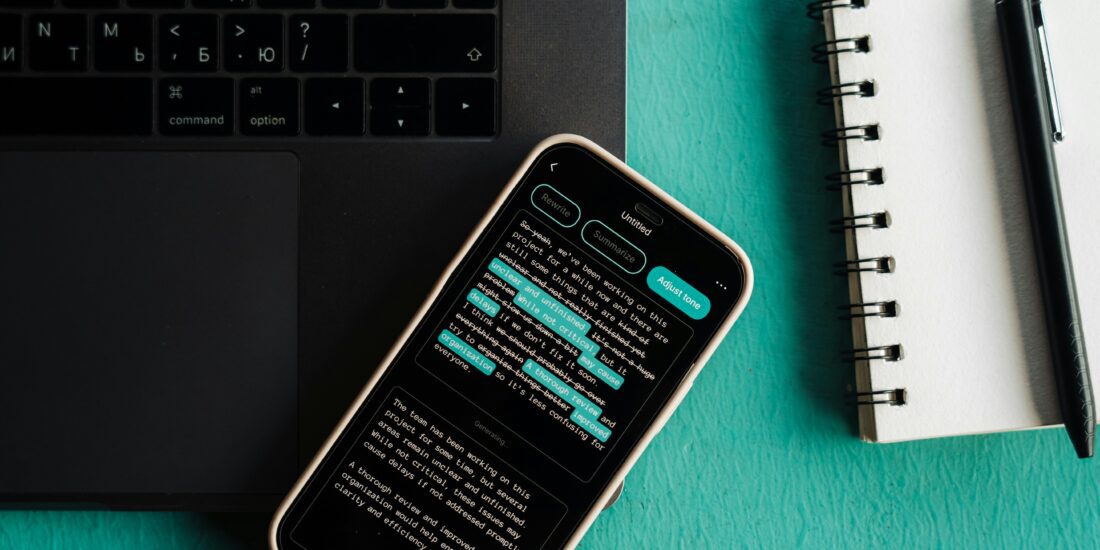

Den slags spørgsmål kræver en helt anden type kvalitative data, som tidligere har krævet omfattende, selvstændige analyser og evalueringer. Men ofte ligger relevante svar allerede i kommunernes egen skriftlige dokumentation. Sprogmodeller har gjort det praktisk muligt at analysere tekst i stor skala, og det, der tidligere var umuligt at overskue – eksempelvis 98 budgetaftaler eller tusindvis af fagudvalgsreferater – kan i dag analyseres systematisk. Sprogmodeller åbner dermed et nyt analytisk rum til at understøtte lokal policyudvikling.

Sådan kommer I fra tusindvis af dokumenter til brugbare indsigter

I Epinion har vi de sidste år arbejdet systematisk med tekst som data. Vi har bygget en database med kommunernes budgetaftaler og udvalgsreferater, som vi bruger til at kortlægge, hvordan kommunerne reelt arbejder med konkrete politikområder – fx til at afdække lokale initiativer til bekæmpelse af ensomhed på tværs af landet; til at undersøge skolepolitikkers formulering af antimobbestrategier; til at identificere læringer på tværs af forskellige kommunale indsatser til at øge danskernes fysiske aktivitet. Med andre ord er tekst som data allerede en del af vores analytiske praksis.

Når den slags analyser skal kunne bære politiske beslutninger, er der nogle ting, vi anbefaler at have styr på fra start:

- Lad ikke de tekniske muligheder definere dine analyser. Før du bruger sprogmodellen, skal du vide, hvad du vil undersøge, og hvordan du vil afgøre, at du har fundet svar på det. Det analytiske design – hvad sammenlignes, mod hvad, og hvordan skelnes der mellem det, der virker, og det, der ikke gør – afgøres af dig, ikke af modellen. Sprogmodeller gør det nemmere at finde mønstre i meget tekst, men de erstatter ikke designet.

- Tag stilling til valideringsbehovet tidligt. Skal resultatet bruges som inspirationsmateriale eller som faktuelt grundlag for en politisk indstilling? Det afgør, hvilken validering der skal lægges ind – om man vurderer ud fra øje-testen alene eller benytter mere samfundsvidenskabelige tilgange.

- Erkend analysens kompleksitet. Du sætter ikke bare alle dine dokumenter ind i en chatrobot og får et brugbart output. Det kræver bearbejdning af teksterne at kunne bruge dem som data, og det kræver etiske og juridiske overvejelser om brug af data, før du indlæser dem.

- Kend modellernes begrænsninger. En sprogmodel finder mønstre i tekst og leverer kun anvendelige resultater, hvis den får en grundig instruks i, hvad den skal lede efter, og hvordan den skal organisere det. Modellen finder mønstre, men den definerer ikke selv, hvad der er værd at lede efter.

- Hold mennesket i loopet. Brug aldrig ikke-valideret AI-output uredigeret, særligt ikke direkte i kritiske beslutninger. Dit analytiske håndværk er stadig det, der afgør, om resultatet kan bære.

- Bland kompetencerne. Den klassiske skelnen mellem kvantitative og kvalitative analytikere giver mindre mening i en sprogmodelsverden. Den kvalitative analytikers blik for kontekst og begreb er præcis det, der løfter en sprogmodelsanalyse fra plausibel til præcis – og den kvantitative analytikers blik for systematik og validering er det, der gør den robust.

Hvis I også er nysgerrige på, hvilke datakilder I sidder på uden at bruge dem, hvilke spørgsmål I kunne stille, men ikke gør, og hvordan I kan komme videre med at bruge AI i jeres analysearbejde, så vil vi meget gerne tale med jer om de oplagte muligheder for jer. Læs også om vores kvalitetssikring og valideringspraksis, når vi arbejder med AI i analyser her.

………………………

Om forfatterne

Denne POV er skrevet af Senior Directors Allan Toft Hedegaard Knudsen og Christian Fischer Vestergaard fra Epinion. Allan leder Epinions Data Science & Analytics-hub og arbejder i krydsfeltet mellem AI, analyse og rådgivning med særligt fokus på anvendelsen af store sprogmodeller. Christian leder Epinions rådgivning inden for Offentlig Sektor. Han har gennem mange år rådgivet danske kommuner og har indgående kendskab til de reformer, styringsvilkår og lokale hensyn, der præger området. Sammen bringer de et perspektiv, der kobler AI, analytisk metode og offentlig praksis.

Christian Fischer Vestergaard

SENIOR DIRECTOR

cv@epinionglobal.com